Siamo entrati in una nuova fase di adozione dell'IA: l'88% dei progetti di IA aziendali si blocca prima di raggiungere la produzione, non a causa di idee scadenti o modelli deboli, ma perché l'infrastruttura non riesce a stare al passo. Le API cloud diventano rapidamente costose. La governance è un aspetto secondario. La latenza si accumula. E per i settori regolamentati, spostare i dati sensibili su un endpoint pubblico non è un’opzione.

Per colmare il divario tra un progetto pilota di IA e la produzione su larga scala è necessario portare l'intelligenza direttamente alla fonte. Cloudera AI Inference Service offre ai team aziendali un livello di servizio del modello di produzione sicuro, performante e conveniente, eseguito direttamente dove risiedono i dati.

Invece di inviare i tuoi dati al cloud come contesto per i modelli, Cloudera ti fornisce i modelli, sbloccando l'intelligenza esattamente dove serve, proteggendola fin dalla progettazione e scalandole con sicurezza dietro il tuo firewall.

3 motivi per cui è importante integrare l'IA nei propri dati: privacy, costi e scelta su larga scala

Mantieni i dati privati e protetti

La maggior parte dei servizi di IA richiede l'invio dei dati al cloud, creando rischi in termini di conformità, costi e latenza. Cloudera adotta l'approccio di portare i modelli dove già risiedono i dati. Che si tratti di un cloud privato virtuale (VPC) sicuro o di un ambiente locale air-gapped (completamente offline e isolato), questa strategia "dal modello ai dati" garantisce che le informazioni rimangano private e controllate, consentendo al contempo un'inferenza ad alte prestazioni per alimentare l'IA in produzione.

Economia prevedibile a lungo termine

L'esecuzione dell'IA nel cloud 24 ore su 24, 7 giorni su 7, comporta spese imprevedibili e in continua crescita. Queste tariffe per richiesta creano un budget che varia in base all'utilizzo, rendendo difficile la previsione a lungo termine. Trasferendo l'inferenza all'infrastruttura già posseduta e controllata dall'organizzazione, i team possono evitare queste tariffe di utilizzo esterne. Una volta che l'IA entra in una fase di produzione stabile, i costi diventano più prevedibili, consentendo un maggiore ritorno sull'investimento con l'aumentare dei carichi di lavoro.

Controllo e scelta

La maggior parte dei fornitori di IA cloud indirizza i clienti verso il proprio ecosistema proprietario, rendendo difficile cambiare, estendere o controllare completamente i propri modelli. Con il servizio Cloudera AI Inference, è possibile implementare un'ampia gamma di funzionalità di IA, dai modelli LLM GenAI open source come Nemotron di NVIDIA ai modelli predittivi tradizionali, senza rinunciare al controllo o alla proprietà della propria proprietà intellettuale. Accelerato dallo stack NVIDIA AI—GPU NVIDIA Blackwell, NVIDIA Dynamo-Triton e microservizi NVIDIA NIM un servizio di modelli scalabile e ad alte prestazioni, il servizio Cloudera AI Inference consente di innovare liberamente mantenendo l'infrastruttura di IA flessibile, portatile e a prova di futuro.

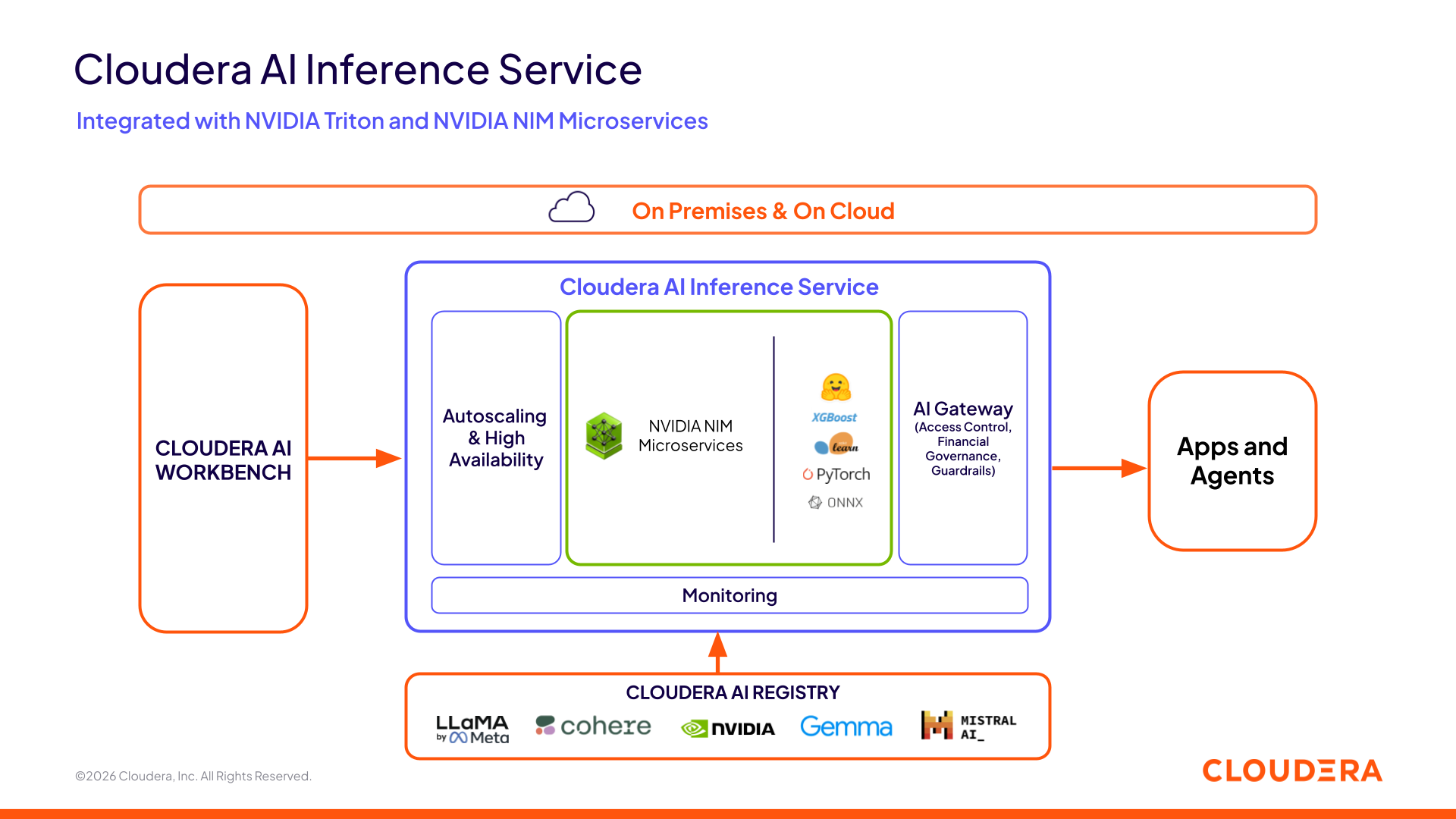

Figura 1: Architettura di Cloudera AI Inference Service

Figura 1: Architettura di Cloudera AI Inference Service

Storie di successo: adozione precoce del servizio Cloudera AI Inference Service in sede

Il servizio Cloudera AI Inference sta aprendo la strada a nuovi casi d'uso dell'IA in contesti in cui il cloud non può arrivare: ambienti offline, infrastrutture sovrane e operazioni critiche in termini di latenza. Ecco tre scenari reali ora resi possibili dal servizio Cloudera AI Inference e già in fase di implementazione presso i primi utenti.

Sicurezza nazionale: intelligence isolata che non dorme mai e non subisce mai fughe di notizie

Nella difesa nazionale, velocità e sicurezza non sono negoziabili. Ma fino a poco tempo fa, gli agenti dei servizi segreti trascorrevano migliaia di ore a setacciare manualmente documenti sensibili offline, rallentati dal processo, sopraffatti dal volume e incapaci di sfruttare gli strumenti di IA pubblici senza rischiare di esporsi.

Ora, con il servizio Cloudera AI Inference in esecuzione all'interno di ambienti air-gapped, le agenzie di difesa possono implementare potenti assistenti LLM in grado di scansionare e riassumere enormi raccolte di documenti in pochi secondi. Questi modelli funzionano interamente offline: senza Internet, senza dipendenze dal cloud, senza perdite di dati, aiutando gli analisti a prendere decisioni più rapide senza compromettere la sicurezza.

Finanza globale: operazioni istantanee, esposizione dei dati pari a zero

La finanza transfrontaliera è presente in decine di lingue. In passato, la traduzione di documenti quali contratti, segnalazioni di frodi o aggiornamenti sulla conformità richiedeva l'utilizzo di strumenti esterni, sollevando serie preoccupazioni in merito all'esposizione dei dati e alla verificabilità.

Oggi, uno dei principali fornitori mondiali di carte di credito sta valutando il servizio Cloudera AI Inference e sta testando l'implementazione on-premise di modelli multilingue per tradurre comunicazioni sensibili in oltre 200 mercati in tempo reale e sotto il pieno controllo interno. Eseguendo l'inferenza sulla propria infrastruttura, l'azienda sta velocizzando le operazioni interne e i tempi di risposta ai clienti, evitando al contempo i rischi di conformità legati alle API di terze parti.

Settore pubblico: agenti AI per ogni dipendente

Le agenzie governative sono sotto pressione per servire più persone in modo più veloce, ma spesso i dipendenti si affidano a portali obsoleti e manuali di politica complessi. Gli strumenti GenAI pubblici non sono un'opzione praticabile a causa dei requisiti di privacy e dei costi imprevedibili.

Le prime implementazioni del servizio Cloudera AI Inference supportano chatbot basati sull'IA on-premise addestrati sulla documentazione interna dell'agenzia. Questi agenti aiutano il personale e gli utenti a orientarsi in argomenti complessi con rapidità e sicurezza, fornendo risposte immediate e mantenendo il pieno controllo sui dati, sui prompt e sui risultati.

Guardando al futuro: il futuro dell'IA è ovunque vivano i dati

Portando il modello dove risiedono i dati, il servizio Cloudera AI Inference aiuta le organizzazioni a scalare l'intelligenza secondo le proprie esigenze, con costi prevedibili e la flessibilità di scegliere tra un'ampia gamma di modelli di produzione. Che si tratti di gestire requisiti di sicurezza air-gapped o di ottimizzare operazioni globali ad alto volume, la strada verso l'IA di livello produttivo è ora aperta.

Cloudera AI la base affidabile per creare, implementare e gestire tutti i tipi di IA, dall'IA generativa e agentica al machine learning tradizionale, in tutto il tuo patrimonio di dati.

Pronto per la scalabilità? Non lasciare che l'infrastruttura limiti la strategia dell'IA. Visita la pagina web del servizio Cloudera AI Inference per demo di casi d'uso, scopri di più in questo webinar o prenota una demo per scoprire come trasformare in realtà l'idea di “IA ovunque”.